ScienceCodeSlam_web

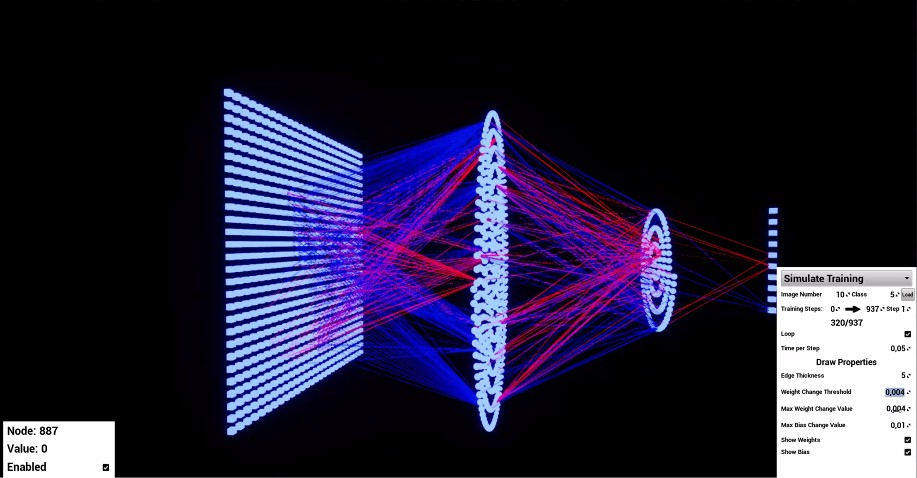

Visualisierung Neuronaler Netze

Mithilfe (tiefer) neuronaler Netze können große Datensätze im Maschinellen Lernen analysiert werden. Das „mehrschichtige Lernen“ findet hierbei auf mehreren versteckten Ebenen im Netz statt. Im Rahmen des Science Code Slams visualisierten Wissenschaftler*innen des ML2R die Schichten neuronaler Netze sowie die darauf basierenden Lernprozesse anhand einer 3D-Simulation. Die Forschenden ermöglichen Nicht-Expert*innen so einen Blick „hinter die Kulis-sen“ neuronaler Netze und erklären ihre Funktionsweise.

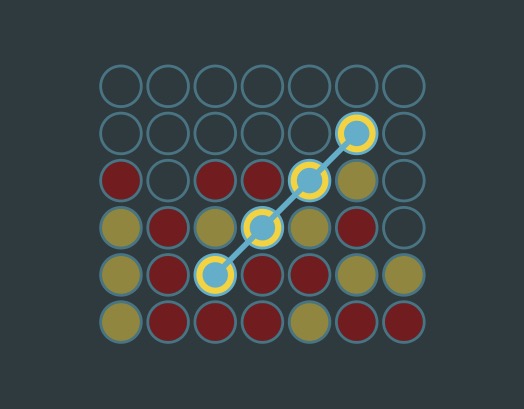

Erklär mir „Vier Gewinnt“!

Methoden für erklärbare maschinelle Lernmodelle sind wichtig, um Künstliche Intelligenz transparenter und für Menschen interpretierbar zu machen. Bei realen Daten können die für eine Modellentscheidung bestimmenden Merkmale jedoch meist nicht eindeutig identifiziert werden. Nur bestimmte regelbasierte Spiele ermöglichen eindeutige Erklärungen für Entschei-dungen – zum Beispiel welcher Spieler gewinnt. ML2R-Forschende trainierten ML-Modelle auf Daten des Spiels „Vier gewinnt“, erstellten Erklärungen mit verschiedenen Methoden und visu-alisierten ihre Ergebnisse, um zu untersuchen, wie gut die Erklärungen mit den in der Realität beobachteten Daten übereinstimmen.

Integrierte Gradienten für natürliche Sprachverarbeitung

„Integrated Gradients“ ist eine Post-hoc-Erklärungsmethode, die Merkmalszuweisungen für eine bestimmte Eingabestichprobe liefert, indem sie diese mit einer Base Line vergleicht. Für die maschinelle Verarbeitung natürlicher Sprache (Natural Language Processing) ist die Methode jedoch nicht gut untersucht – gerade auch im Hinblick auf die Wahl einer geeigneten Base Line. Im Science Code Slam erprobten ML2R-Forschende die „Integrated Gradients“-Methode auf verschiedenen Bilddatensätzen und evaluierten die Ergebnisse anhand einer interaktiven Visualisierung. Vielversprechende Ergebnisse zeigten sich auch in den Tests einer neuen Base Line.

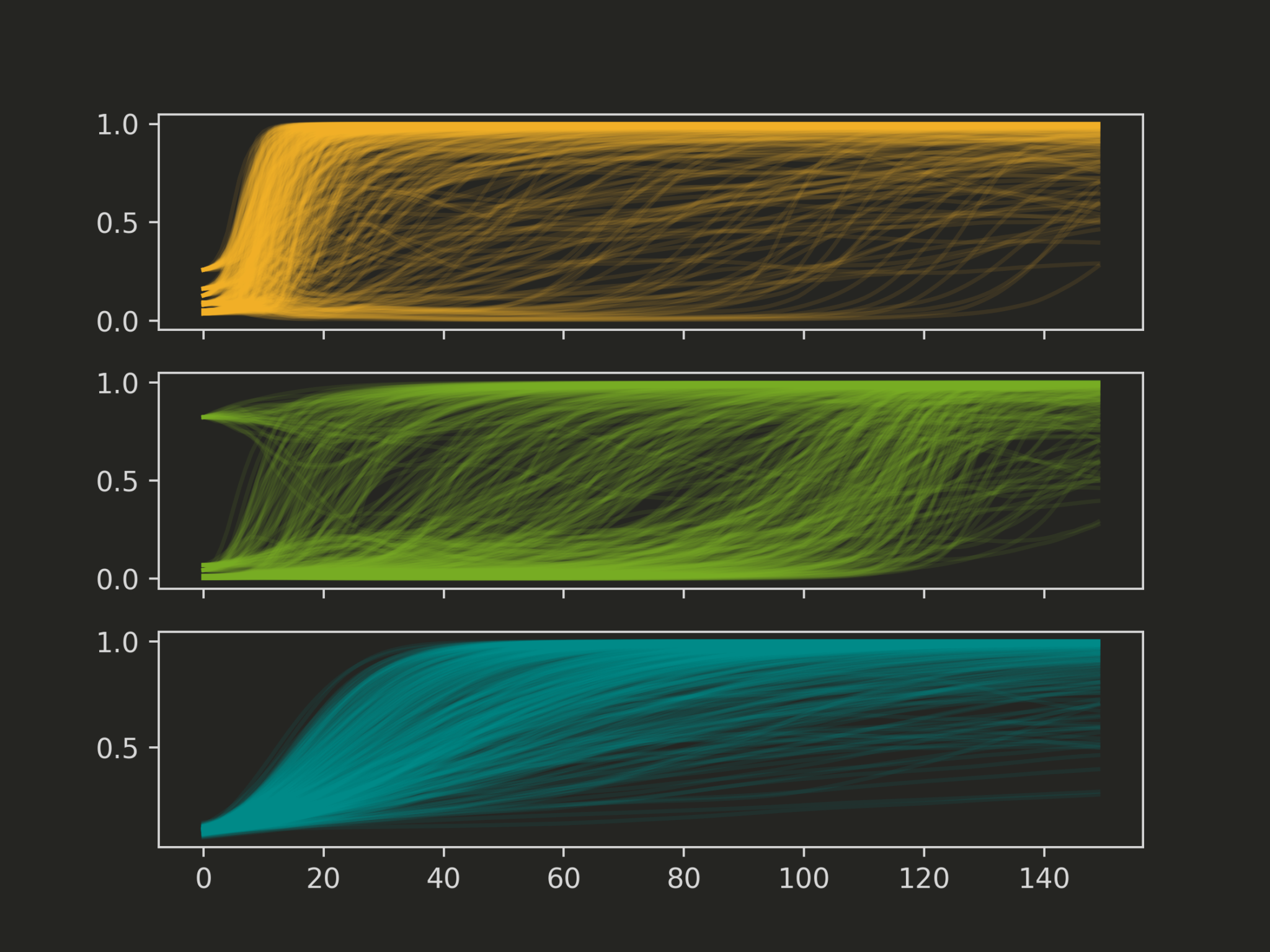

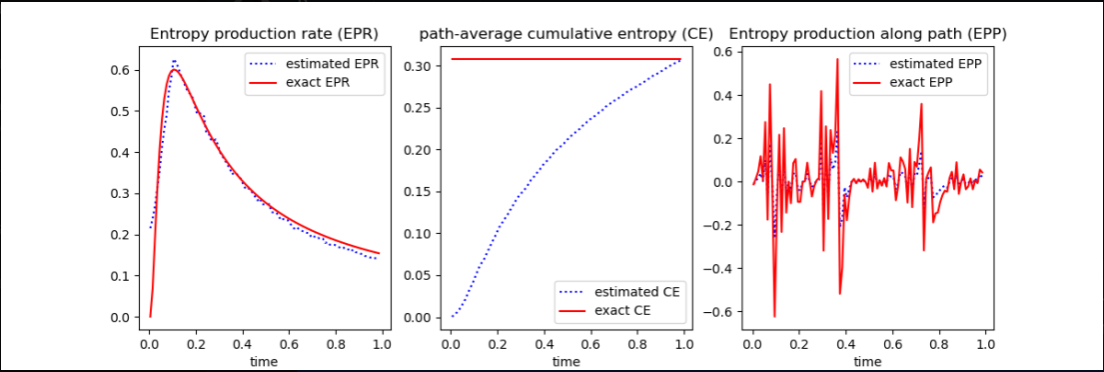

Stochastische Thermodynamik für Generative Modelle

Ein kürzlich entwickeltes Konzept, das sowohl in der statistischen Physik als auch in der Thermodynamik des Rechnens grundlegend ist, ist die Entropieänderung entlang eines stochastischen Pfades. Solche Entropieänderungen stehen in engem Zusammenhang mit Informationsflüssen und sind relevant für Fragen der maschinellen Lerneffizienz. In der Praxis sind sie jedoch schwierig zu berechnen. ML2R-Forschende entwickelten eine neue Methode, um Entropieänderungen einzig entlang von Trajektorien-Daten mit neuronalen Netzen zu schätzen. Die Abbildung zeigt einen Vergleich zwischen exakten Ergebnissen und ihren Schätzungen für das „breathing parabola model“.

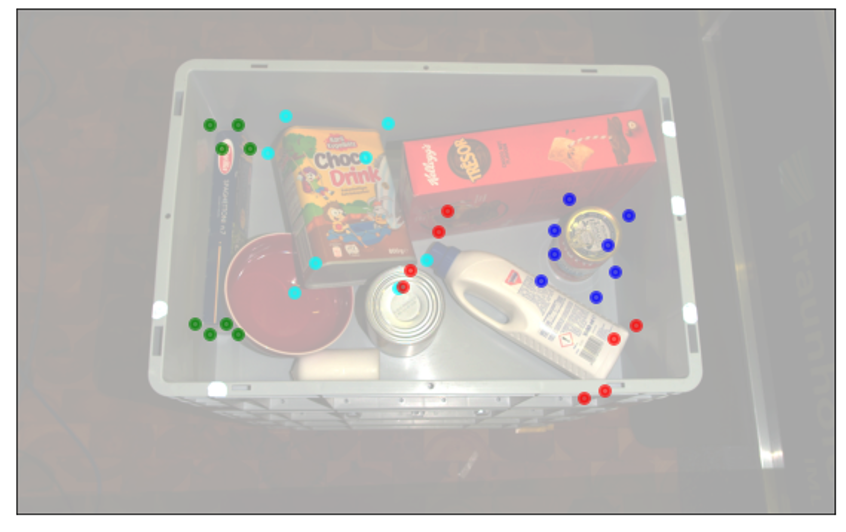

Entdecke mich, wenn Du kannst!

Convolutional Neural Networks (CNNs) - faltende neuronale Netze – eignen sich sehr gut für die maschinelle Bildverarbeitung und erlauben so die erfolgreiche Automatisierung von Aufgaben für autonome Roboter, wie das gezielte Greifen von Objekten. Eine Arbeitsgruppe des Science Code Slams trainierte einen im ML2R erstellten Datensatz für Objektsegmentierung und Positi-onsbestimmung anhand von zwei CNNS ("SingleShot pose" und "CozyPose" Netze). Der Datensatz enthält RGBD-Segmentierungsmasken, 6D-Pose- und 3D-Wolken-Datenannotationen.

Wie schreibe ich einen guten Blogbeitrag?

Seit fast einem Jahr gibt der ML2R-Blog Leser*innen wöchentlich Einblicke in Konzepte, An-wendungsfälle und Forschungsergebnisse Künstlicher Intelligenz. Der diesjährige Science Code Slam bereitete ein Forum für erfahrene Blogger*innen und engagierte Erstautor*innen inner-halb des Kompetenzzentrums, um sich gemeinschaftlich dem Thema erfolgreicher Wissen-schaftskommunikation zu widmen. Auf der Suche nach dem „perfekten Bild“, aussagekräftigen Überschriften und einem passenden Thema verfassten die Forschenden eigene Blogbeiträge.

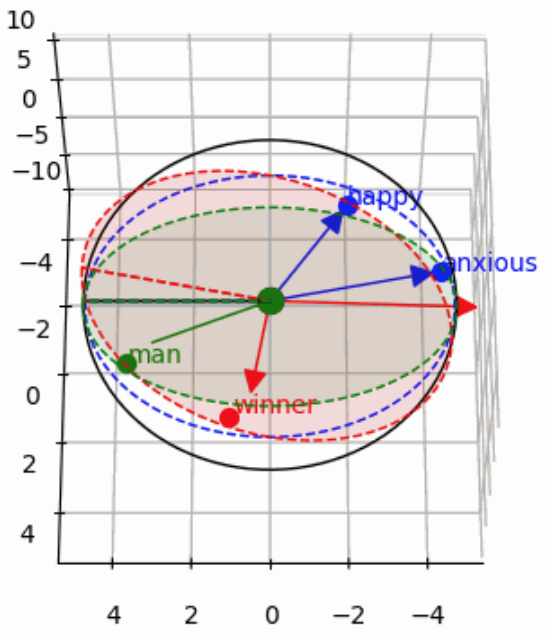

Rotierende Sphären für Bedeutungsrepräsentation

KI-Wissenschaftler*innen nutzen Vektoren, um die Bedeutung von Wörtern zu repräsentieren und so für ML-Systeme nutzbar zu machen. Ein im ML2R entwickelter Ansatz ermöglicht darüber hinaus, Vektoren und symbolisches Wissen ohne Informationsverlust zu rotierenden Sphären zusammenzuführen. Die Bewegung der Sphären simuliert die Denkweise des menschlichen Ver-standes. Anhand eines Witzes untersuchte eine Projektgruppe des Science Code Slams, wie Bedeutungen und Bedeutungsrepräsentationen von Wörtern, Phrasen und Sätzen durch rotie-rende Sphärenmodelle repräsentiert werden können.